虚拟化GPU服务简述

虚拟化GPU服务是一种弹性GPU计算服务,用户可以根据业务需求选择比一颗物理GPU更小的计算资源来部署自己的业务。该服务旨在帮助用户降低GPU计算成本提高业务运维效率。

虚拟化GPU实例的用法与普通弹性计算实例一样便捷,用户可以使用Web控制台或者OpenAPI方式配置和购买服务。用户在使用过程中可以完全掌控该实例,该实例在阿里云计算环境中运行,还可以配合其他云服务一起使用。当用户业务遇到业务高峰时可以在数分钟内扩展新的实例来适应业务增长。用户在虚拟化GPU服务的使用全过程中均可以享受到在线服务咨询和快速故障处理服务。

虚拟化GPU服务有什么不同?

通过设备直通方式提供物理GPU加速器

仅支持作业离线迁移

重负载GPU加速计算

深度学习训练与推理计算

HPC计算

重载图形计算

弹性计算服务实例

业务扩展以单颗物理GPU资源方式增加

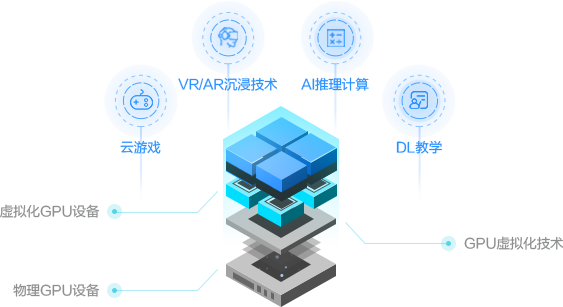

通过GPU虚拟化方式提供虚拟GPU加速器

*支持作业在线迁移

轻负载GPU计算

轻负载的深度学习推理计算

深度学习教学场景

云游戏与VR/AR场景

弹性计算服务实例

业务扩展以更小粒度GPU资源方式增加(例如:1/8或1/4颗Tesla P4的资源)

图形与AI计算场景全覆盖

虚拟化GPU服务是通过GPU虚拟化技术将物理GPU资源进行切分,虚拟化的GPU依然具有物理GPU的所有计算特性。

用户可以使用虚拟化GPU实例搭建自己的AI推理计算业务,云端图形工作站或者游戏业务

图形计算

图形计算单颗物理GPU的计算能力越来越强,虚拟桌面,图形设计以及云游戏和VR/AR应用则在部分场景下需要小粒度的GPU计算资源。

云游戏和VR/AR应用在批量部署时使用虚拟化GPU实例,成本优势也将极为明显。

深度学习计算

深度学习计算在深度学习的训练计算场景中,虽然对单颗GPU的性能要求与日俱增,但在诸多深度学习推理计算场景中,则需要小粒度的GPU计算资源。

在AI应用普惠化的背景下,小粒度的虚拟化GPU实例更加贴合用户业务场景,帮助用户降低业务支出。

虚拟化GPU服务带来的业务部署优势

在互联网业务中,批量部署成本和快速弹性伸缩是用户的主要关注点。

批量部署的成本优势和快速弹性伸缩可以帮助用户自如应对业务变化,提高业务效率和减少业务支出

批量部署成本

批量部署成本在诸多图形计算和AI推理计算的场景中,用户通常并不要求单GPU实例的计算性能十分强大,而是更加关注业务在批量部署中的成本。小粒度的虚拟化GPU实例则更加合适这些场景,很好的平衡用户业务在批量部署中的成本需求。

快速弹性伸缩

快速弹性伸缩拥有了小粒度的虚拟化GPU实例,用户不必再为了匹配较强的物理GPU资源而将服务部署成为复杂的胖服务节点,而是可以基于容器方式将有GPU计算需求的服务都解耦部署在不同的虚拟化GPU实例节点上。这样部署的瘦服务节点更加有利于快速弹性伸缩,在业务的任何时刻都可以应对自如,提高业务运维效率。

虚拟化GPU服务的典型使用场景

云游戏

云游戏随着5G移动通信业务的快速展开,云游戏发展最大的阻碍带宽和延时得以消除,基于云端计算的云游戏有着诸多优势。例如:使用相同配置的虚拟化GPU实例,用户的游戏运行基础环境变得统一可控,更有利于游戏开发团队提供更多高质量的图形游戏给游戏用户而不必担心游戏用户的游戏机配置和性能不匹配。

VR/AR

VR/AR5G移动通信带来的另一个机会是VR/AR,基于云端GPU加速的VR/AR应用也将不再依赖昂贵的专用终端,推广起来也变得更加容易,用户仅需要基于手持移动设备或者家中的电视即可实现VR/AR应用。

AI推理

AI推理随着AI技术的普及,基于AI技术的互联网应用也变得更加普遍,而这些应用更多使用轻量级的AI算法模型,且更加依赖于基于容器的弹性部署,小颗粒的虚拟化GPU实例则更加适合这样的计算场景。

DL教学

DL教学AI技术与传统产业的结合变得越来越深入,AI技术也成为了国家战略,培养更多的AI人才也变成了必须。高等院校和领先的AI培训机构也越来越多依赖于云端GPU实例作为教学实验资源。小颗粒的虚拟化GPU实例则具有更好的成本优势且可以使用镜像方式批量部署,更加便利搭建深度学习教学实验环境。

虚拟化GPU服务在应用上的优势

降低批量部署成本

实现快速弹性伸缩

提高运维效率

*即将支持

中国站

中国站

International

International